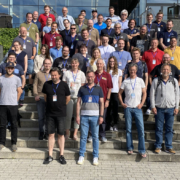

Nachdem 2021 Präsenz-Konferenzen die Ausnahme waren, boten die meisten Veranstalter dieses Jahr entweder Hybrid- oder auch reine Vorort-Konferenzen an. Neben der Pycon in Berlin und M3 (Minds Mastering Machines) in Karlsruhe durfte ich zudem auch dem Debüt des Datalift Summit beiwohnen.

Der DataLift Summit wird organisiert von der AI guild, einem Deutschland weit agierenden Community von “data practitioners”. Ein hipper Berliner Co-Workingspace bot Räumlichkeiten für drei parallele Tracks sowie einen Innenhof, in dem sich die rund 300 Teilnehmer kennenlernen konnten. Networking war erklärtes Ziel der Konferenz, aus diesem Grund waren die 45 Minuten Vorträge meist kurze 20 Minuten Impulse aus der Praxis, gefolgt von Q&A, die teils in eine muntere Gruppendiskussion mündete. Darüber hinaus enthielt das Programm viele Pausen, um ausreichend Raum für persönlichen Austausch zu schaffen sowie zusätzlich Meetups am Abend in den Räumlichkeiten der Sponsoren.

Inhaltliche Schwerpunkte:

MLOps war über alle drei Konferenzen hinweg eines der häufigst diskutieren Themen. Obwohl der Begriff allgegenwärtig ist, hat sich noch kein klarer Technologie-Stack hervorgetan. Zalando präsentierte auf dem DataLift Summit in einer dreiteiligen Vortragsreihe ihre interne Lösung, die vor allem auf zahlreichen Eigenentwicklungen wie etwa zflow basiert. GetYourGuide hingegen setzt mehr auf Open Source Lösungen rund um das generell sehr beliebte MLflow, kombiniert mit BentoML zwecks model serving. Generell beliebt war auch die Nutzung von Databricks Notebooks, nicht zur Daten Exploration sondern sogar zwecks Data Preprocessing innerhalb von ETL PipelinesFür mich überraschend setzt derzeit niemand der Anwesenden auf Kubeflow und die damit verbundenen Tools wie Katib (Hyperparameter Tuning), ArgoCD (Orchestrierung) und SeldonCore (model serving). Insbesondere dank Googles neuen VertexAI als managed Kubeflow für Google Cloud Nutzer bietet dieses nun eine mächtige Alternative im MLOps Bereich.

Weitere wichtige Themen waren Erklärbarkeit, Nutzer-Akzeptanz und Datenqualität. Footprint, ein Start-up zur Bestimmung der Schuhgröße, beschrieb die Herausforderung in der Nutzerkommunikation, um ein valides Foto der Füße zu erhalten. Tchibo beschrieb, wie sie Google’s neuen Temporal Fusion Transformer zur Abverkaufsprognose nutzen, auch da dieses Modell eine Feature-Eklärbarkeit bietet. Bezüglich Datenqualität möchte ich noch einen sehr guten

scieneers Workshop zu visueller Datenexploration

Nach eineinhalb Vortrag-Tagen war der Freitag für Workshops vorgesehen. Hier durfte ich die Teilnehmer drei Stunden durch Visual Data Exploration with Python führen. Hier das wichtigste in Kürze:

- Visualisierungen werden typischerweise zur Ergebnisvorstellung eingesetzt und sollten daher in der Regel eine klare Nachricht vermitteln.

- Bei explorativer Visualisierung hingegen müssen die Einsichten erst gefunden werden, weshalb einer schnelle Chart-Modifikation Vorzug vor Visualiserungsdetails gegeben werden sollte.

- Für den Einstieg in eine EDA eignen sich Reports von dataprep oder pandas-profiling zur ersten Orientierung. Anschließend sollten die Daten mit Blick auf natürliche Gruppen (bpsw. Marken), zeitliche Aggregationen (bspw. Tage) und geographische Informationen (bspw. Standorte) analysiert werden.

- Python bietet zahlreiche Bibliotheken zur Datenvisualiseriung, wobei sich für explorative Aufgaben vor allem interaktive, high-level Tools eignen:

- Plotly-Express bietet zahlreiche mächtige Visualisierungen hinter einer kompakten, intuitiven API. Dabei sind alle Charts automatisch interaktiv, ermöglichen etwa das Filtern nach Farben oder das Zoomen in Scatter Charts.

- Altair folgt der Grammer of Graphics und ermöglicht damit frei kombinierbare Visualisierungen, welche durch “Bindings” miteinander verbunden werden können. Dies ermöglicht es etwa in einem Chart einen Filter für die Daten eines anderen Charts zu konfigurieren.

- Charts können mit Python zudem einfach in interaktive Dashboards verwandelt werden, um so bspw tiefer in einzelne Subgruppen einzutauchen. Tools hierfür sind:

- streamlit: Intuitive Nutzung und große Community

- Voilá: Minimalistische Umwandlung von Notebooks mit ipython-widgets in Dashboards

- Panel: Flexibles Framework für jede Art von Dashboards, erfordert etwas Übung

Wer tiefer in den Workshop einsteigen möchte, dem sei das GitHub-Repo empfohlen. Ansonsten hoffen wir, euch im nächsten Jahr oder einer der anstehenden Herbst Konferenzen (etwa der Data2Day) persönlich kennenzulernen.

Adi Goldstein

Adi Goldstein

Steag New Energies GmbH

Steag New Energies GmbH

Photo courtesy of Lwala Community Alliance

Photo courtesy of Lwala Community Alliance